Polarización y dominio: los riesgos de la guerra global por la inteligencia artificial

Los gigantes tecnológicos alrededor del mundo están en una carrera por encontrar los mejores usos y aplicaciones para esta tecnología, pero su posible impacto se extiende hasta los usos bélicos y antidemocráticos

Cuando una tecnología llega al mundo, sus usos pueden variar dependiendo de las manos que la utilicen. En el siglo XX, la energía nuclear permitió alumbrar y destruir ciudades enteras alrededor del mundo. Ahora, la inteligencia artificial (IA) nos abre las puertas de una nueva revolución industrial y los expertos del mundo compiten por encontrarle usos constructivos y destructivos. .

“La IA será el motor de la innovación en los próximos años: se prevé que, en 2035, la mitad del crecimiento de muchos países europeos podría estar impulsado por la inteligencia artificial. La IA ya ha producido cambios muy profundos en diferentes áreas y sectores como la salud, la automoción y, por supuesto, en los servicios online”, responde Justo Hidalgo, director de IA de Adigital. Hidalgo añade que en cuanto a inversión, la “primera ola” de la inteligencia artificial ha estado liderada por Estados Unidos y China, y a distancia la Unión Europea. No obstante, no descarta que los Veintisiete puedan alcanzar un nivel competitivo próximamente.

Sin embargo, el sector privado es la estrella de esta revolución. Así, la lucha se está dando entre los gigantes tecnológicos que compiten por la hegemonía. “Vemos un salto cuántico en las próximas aplicaciones de la inteligencia artificial, similar a la introducción de internet. Microsoft lleva sin duda ventaja con ChatGPT. Esto llevará a empresas como Google, Amazon, Meta y Apple a invertir fuertemente. Aparte de Microsoft, los grandes ganadores de este desarrollo serán los valores de semiconductores como Nvidia, Taiwan Semi, ASML, Advantest y Arista Networks”, asegura Frank Schwarz, gestor en MainFirst.

Gigantes de la industria

Las inversiones han llegado de forma casi súbita a un campo del que hasta hace unos años no se hablaba. La proporción de empresas que adoptaron la IA en 2022 se ha más que duplicado desde 2017, aunque se ha estancado en los últimos años entre el 50% y el 60%, en base a los resultados de una encuesta anual de McKinsey.

Según Schwarz, el ascenso de Chat GPT podría ser catastrófico para Alphabet (la matriz de Google) “Si Microsoft logra integrar de forma exitosa ChatGPT en su motor de búsqueda Bing, algunos de los lucrativos ingresos publicitarios de Google estarían en peligro”, explica el experto. Por su parte, Meta ha decidido redireccionar sus esfuerzos en el metaverso y ha anunciado su AI Sandbox, un paquete de herramientas para que los especialistas en marketing puedan crear anuncios y hacerlos más efectivos.

Schwarz destaca que las empresas asiáticas tampoco pierden el tiempo. “Baidu atrajo la atención del mundo de la tecnología con la presentación en marzo de Wenxin Yiyan, llamado bot Ernie en inglés. Es probable que JD.com, Netease y Tencent presenten más herramientas de IA. Queda por ver qué empresas ganarán la carrera mundial”, añade. De hecho, la agencia Bloomberg reveló recientemente que la red social china TikTok también trabaja en una herramienta de inteligencia artificial generativa. La red social está probando un chatbot llamado Tako, que puede responder preguntas y tener conversaciones con sus usuarios.

El Artificial Intelligence Index Report 2023 de la universidad de Stanford muestra que tan solo en Estados Unidos los inversores apostaron por unas 542 empresas nuevas en el sector en 2022. Mientras tanto, en China se financiaron unas 146, en el Reino Unido unas 99 y en el total de la UE alrededor de unas 100. Fuera de ellos, compañías como Samsung han decidido apostar por fortalecer su industria de semiconductores y además está buscando incorporar la inteligencia artificial a sus sistemas para móviles, electrodomésticos y a su asistente Bixby (similar al Siri de Apple).

En contraste, el avance en Europa no es tan fluido como del otro lado del Atlántico. “Para continuar por la senda adecuada, Europa tiene que ser capaz de convertir los avances académicos y técnicos en ventajas comerciales. Este espacio entre el avance académico y la innovación industrial es clave en los próximos años”, comenta Hidalgo. El experto de Adigital agrega que la inversión europea en el sector, tanto pública como privada, está muy lejos de lo que ocurre en otras geografías. “Solo el 3% de los unicornios de IA del mundo son europeos, y la inversión privada en inteligencia artificial en Europa es diez veces inferior a la de EE UU y cinco veces menor que en China”, resalta.

En este contexto, algunos expertos critican que la concentración del poder de procesamiento necesario para desarrollar los sistemas de IA están en manos de unas pocas corporaciones. “Existe la preocupación de que cuanto más nos apoyamos en la IA como sociedad, más dependientes nos volvemos tanto para la investigación y el desarrollo (I+D) como para las operaciones diarias en infraestructuras propiedad de un puñado de corporaciones de hiperescala domiciliadas en el extranjero”, afirma Vili Lehdonvirta, profesor del Oxford Internet Institute.

En esta línea, está claro que son principalmente estos dos países los que están liderando la revolución. “El mundo se está alejando silenciosamente de una orientación liberal basada en la interoperabilidad global, mientras que el desarrollo tecnológico se enreda cada vez más en la competencia entre los gobiernos de Estados Unidos y China. Estos desarrollos reducen las perspectivas de encontrar formas internacionales de cooperación en materia de gobernanza de la IA y podrían contribuir a una balcanización de los ecosistemas tecnológicos”, opina Benjamin Cedric Larsen, jefe de proyectos de IA en World Economic Forum.

El resultado, según Larsen, sería el surgimiento de una red “china” y su ecosistema digital, estadounidense y europeo, cada uno con sus propias reglas e idiosincrasias de gobierno. “A la larga, esto puede significar que será mucho más difícil ponerse de acuerdo sobre cómo deben regularse y gobernarse las formas más complicadas de inteligencia artificial”, señala el experto.

Preocupaciones

En este contexto, los principales actores están conscientes de los riesgos. El CEO de OpenAI, Sam Altman, se ha mostrado favorable a la regulación y exige que las compañías del sector tengan que sujetarse a una “combinación de requisitos de licencia o registro” para evitar riesgos. Un análisis del gigante tecnológico Intel refleja el acelerado (y preocupante para algunos) avance de la inteligencia artificial. Según la empresa, el entrenamiento de la IA creció más de cien millones de veces más rápido que la ley de Moore, el conocido postulado que afirma que la velocidad de los ordenadores se duplica cada dos años. En este contexto, un grupo de más de 10.000 expertos firmó recientemente una carta abierta en la que se apelaba a todos los laboratorios de IA para que “pausen inmediatamente durante al menos seis meses el entrenamiento de los sistemas de IA más potentes que GPT-4″.

Por otra parte, el impacto de esta tecnología en el empleo preocupa a muchos sectores. A finales de marzo, Goldman Sachs calculaba en un informe que tanto en Estados Unidos como en Europa uno de cada cuatro empleos desaparecerán por el efecto de esta tecnología. En términos globales, el 18% de los puestos de trabajo del planeta son susceptibles, según el banco, de ser sustituidos por la IA.

Asimismo, el economista jefe de Microsoft, Michael Schwarz, aseguró recientemente que opina que la IA puede llegar a ser peligrosa en manos de personas sin escrúpulos. “Estoy seguro de que la IA será utilizada por malos actores, y sí, causará un daño real”, dijo Schwarz durante un panel del Foro Económico Mundial en Ginebra el pasado miércoles. “Puede causar mucho daño en manos de los spammers con elecciones y demás”.

Tecnología de guerra

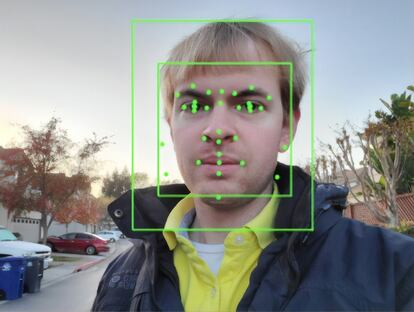

Era de esperar que en cuanto la inteligencia artificial se comenzó a popularizar uno de los primeros interesados fuera el sector de la defensa. Ciertamente, las herramientas digitales han sido desde la mitad del siglo XX un elemento clave para mantener la ventaja táctica y tecnologías, como el reconocimiento facial y los drones no tripulados que se utilizan de forma diaria en este sector desde hace más de una década.

Por ejemplo, este mes Palantir presentó su Plataforma de Inteligencia Artificial (AIP, por sus siglas en inglés), que puede ser utilizada por las fuerzas militares para tomar decisiones en el campo de batalla con ayuda de modelos similares a ChatGPT. La compañía explica que, por ejemplo, este software puede nutrirse de redes de información, comunicación e inteligencia para reportar cuántas unidades tiene un ejército en una región. Asimismo, puede dar sugerencias de cómo administrar los recursos para poder plantear una estrategia de respuesta ante una amenaza. No obstante, la empresa enfatiza que este software se tiene que utilizar dentro de los marcos de la ética y de las convenciones a las que se someten todas las tecnologías de defensa.

En esta línea, entidades como la Cruz Roja advierten de que la impredictibilidad de la IA puede dar un nuevo empuje negativo a las ya controvertidas armas autónomas. “Por ejemplo, en la vigilancia, los sistemas de aprendizaje automático plantean preocupaciones sobre el sesgo codificado, incluso en términos de raza, género y sexo. Con todas las armas autónomas puede ser muy difícil para un usuario predecir los efectos”, avisan desde el Comité Internacional de la Cruz Roja.

Riesgo democrático

Las implicaciones de estas nuevas herramientas en los procesos democráticos y los Gobiernos son otro aspecto que preocupa a los expertos, que sugieren que pueden utilizarse para potenciar la manipulación de la opinión pública, algo que se viene viendo en las campañas electorales de todo el mundo desde hace una década y que se puede complicar aún más con las herramientas de deepfakes y creación de imágenes, vídeo y texto.

Los especialistas advierten de que, por ejemplo, el Gobierno chino podría utilizar la alta concentración de usuarios que tienen sus superaplicaciones (como WeChat) para fortalecer su control sobre la ciudadanía.

Así lo asegura Matt O’Shaughnessy, investigador de Carnegie Endowment for International Peace: “El borrador de una propuesta de ley reciente muestra una intención obvia de fortalecer el control sobre la tecnología y los ecosistemas de información de China. Según las reglas, se requeriría que el contenido generado refleje los valores fundamentales socialistas. Se prohibiría el contenido que contribuya a la subversión del poder estatal”.

Mathias Rissa, director del Centro Carr para la Política de Derechos Humanos, indica que, a menudo, la tecnología también es usada por las autocracias para controlar a su población, como ya lo hace el Gobierno chino. “Las bases de datos secretas y las aplicaciones de inteligencia artificial han tenido efectos nocivos en sectores como el financiero, los negocios, la educación y la política. Las decisiones basadas en IA sobre libertad condicional, hipoteca o solicitudes de empleo a menudo están sesgadas”, afirma Rissa.

En este contexto, Larsen explica que, mientras los Gobiernos autoritarios como Rusia y China están orientando la regulación hacia el control de la población, en Occidente hay una tendencia hacia proteger la privacidad y los datos de los usuarios: “Hasta cierto punto, los valores estadounidenses y europeos se están convirtiendo en un mecanismo ideológico que tiene como objetivo garantizar un enfoque centrado en los derechos humanos del papel y el uso de la IA”.

Sigue toda la información de Cinco Días en Facebook, Twitter y Linkedin, o en nuestra newsletter Agenda de Cinco Días