Si tus conversaciones de ChatGPT empiezan a ir muy lentas, esta es la única solución

Ya no tendrás que esperar eternamente para recibir una respuesta

ChatGPT es uno de los mejores chatbots que puedes utilizar en todo tipo de tareas. Pero tiene una limitación muy molesta: si mantienes una conversación durante mucho tiempo, acaba siendo imposible de utilizar.

Un problema que muchos usuarios suften y que suele aparecer cuando más necesitario es el chatbot de OpenAI. Así que, si estás investigando las causas y posibles soluciones, te contamos qué puedes hacer si las conversaciones de ChatGPT se atascan o van demasiado lentas.

ChatGPT se atasca en conversaciones largas, y es un problema de cualquier LLM

Si tienes conversaciones puntuales con ChatGPT, todo fluirá de forma normal y disfrutarás de la mejor experiencia. Pero si mantienes esa conversación durante un tiempo prolongado, llegarán los problemas.

Y lo más curioso, es que esas conversaciones con ChatGPT que se atascan funcionan perfectamente en el móvil, o por lo menos recibes respuestas más rápido y hay menos errores. ¿Qué está pasando?

Investigando por Internet, la conclusión es muy sencilla: los chats largos se vuelven lentos porque ChatGPT necesita procesar una enorme cantidad de texto (tokens) y porque el navegador colapsa al intentar mostrar todo el historial en pantalla.

La app móvil va mejor porque muestra menos, carga menos y libera memoria mejor. En cambio, el navegador carga toda la conversación completa, aunque tenga 200 mensajes, y eso lo ralentiza brutalmente.

Ya te adelantamos que es un problema que, de momento, no tiene una solución en forma de borrar caché o utilizar extensiones. Lo he probado todo y no funciona. Pero sí hay una forma de prevenir este problema y usar el truco que te vamos a decir para que ninguna conversación de ChatGPT se atasque.

Cómo solucionar el problema de los chats de ChatGPT que van lentos

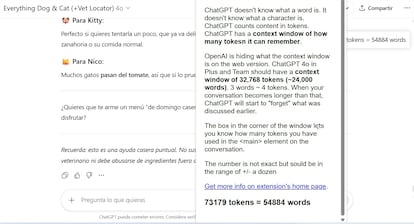

Y para ello, usaremos esta extensión gratuita. Hablamos de ChatGTPT Token Counter, una herramienta gratuita que te ayuda a saber cuándo una conversación con ChatGPT llega a su límite.

Esta extensión servirá de “chivato”. En el momento en el que superes los 24.000 tokens, comienzan las curvas y ChatGPT cae en términos de rendimiento. Y para saberlo, solo tienes que abrir la extensión. En la imagen que hay sobre estas líneas, donde he mantenido conversaciones con un chatbot especializado en mascotas, verás que he superado ampliamente ese límite, superando los 73.000 tokens, por lo que está claro que esa conversación no fluirá bien.

Ahora, lo que hay que hacer para poder seguir hablando con ChatGPT con normalidad, es copiar la conversación y pegarla en una nueva. Para ello, tienes dos opciones: por un lado, prueba a crear un PDF de toda la conversación. Si, como en mi caso, es demasiado larga y el modelo no es capaz, debes recurrir al propio ChatGPT.

Para ello, abre la conversación que se atasca en el chat desde el móvil, ya que funciona mucho mejor, y le pides que te haga un resumen completo ya que el chat funciona mal y necesitas crear uno nuevo, pero que no pierda contexto. Pídele que sea lo más detallado posible.

Esta última conversación generada la pegas en un nuevo chat y empiezas de nuevo. Además, como ya tendrás el contador de tokens a mano, puedes tener un buen control de las líneas escritas para saber que, al alcanzar los 24.000 tokens, toca cambiar de conversación.

Ya te hemos dicho que no es la mejor soución, pero a día de hoy no hay otra manera. Y por mucho que limpies caché o instales todo tipo de extensiones, como superes los 24.000 tokens, ChatGPT caerá en rendimiento.